InfiniBand(簡稱IB)是一種高性能、低延遲的網絡互連技術,廣泛應用于高性能計算(HPC)、數據中心和人工智能等領域。其核心硬件組件——InfiniBand網卡,憑借一系列卓越特性,為現代計算系統的軟硬件技術開發提供了強大的底層支撐。

一、InfiniBand網卡的核心特性

1. 超高帶寬與低延遲:

當前主流的InfiniBand網卡(如HDR 200Gbps、NDR 400Gbps)提供了遠超傳統以太網的帶寬。更重要的是,其端到端延遲可低至亞微秒級,這對于需要頻繁進行小消息通信的并行計算應用至關重要。

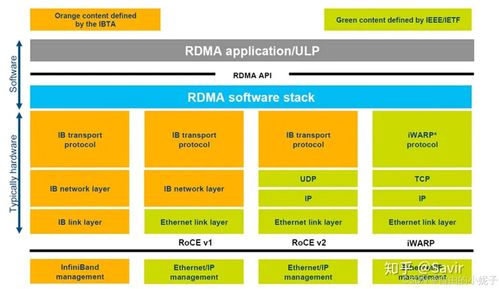

2. 遠程直接內存訪問(RDMA):

這是IB網卡的標志性功能。RDMA允許網絡適配器直接訪問對方主機的內存,無需操作系統內核和CPU的介入。這實現了“零拷貝”數據傳輸,極大降低了CPU開銷,提升了通信效率和系統整體性能。

3. 內核旁路(Kernel Bypass):

與RDMA緊密相關,應用程序可以直接與網卡交互,繞過繁瑣的內核協議棧。這減少了上下文切換和系統調用,進一步降低了延遲,使通信性能更加可預測。

4. 傳輸卸載與硬件加速:

IB網卡在硬件層面實現了傳輸層協議(如可靠連接、數據包排序、流量控制)的卸載。這包括擁塞控制、原子操作、多播等高級功能的硬件加速,將CPU從繁重的網絡協議處理中解放出來。

5. 可擴展性與服務質量(QoS):

IB架構天然支持大規模集群的線性擴展。其基于信用的流控機制和虛擬通道(VL)技術,能夠為不同流量提供差異化的服務質量保障,確保關鍵應用的低延遲和高吞吐。

6. 高能效比:

在處理相同數據量時,IB網卡憑借高效的硬件卸載和RDMA技術,通常比傳統TCP/IP over Ethernet消耗更少的CPU資源和系統功耗,實現更高的能效比。

二、在計算機軟硬件技術開發中的關鍵作用

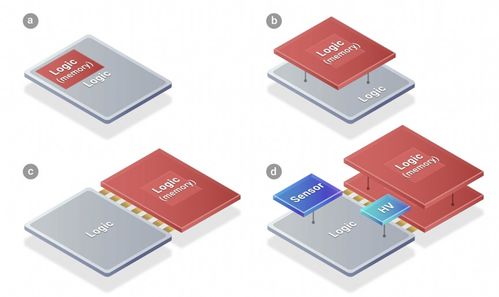

1. 硬件架構創新:

IB網卡的高性能特性,推動了服務器和存儲系統硬件架構的演進。例如,在異構計算系統中,CPU、GPU、FPGA等加速器可以通過IB網絡直接進行高速內存訪問(如GPUDirect RDMA),實現計算資源的緊密耦合與高效協同,為AI訓練和科學計算等負載提供近乎線性的擴展能力。硬件開發者需深入研究IB網卡的PCIe接口規范、散熱設計和信號完整性,以充分發揮其性能。

2. 系統軟件與中間件開發:

操作系統和虛擬化層需要提供對IB和RDMA的原生支持。這包括:

- 驅動與協議棧開發:如Linux內核中的

mlx5<em>ib驅動、rdma</em>cm通信管理器以及用戶態的libibverbs和librdmacm庫。開發者需要優化這些軟件層,以最小化軟件開銷。

- 虛擬化與云化支持:開發SR-IOV(單根I/O虛擬化)等技術,讓虛擬機或容器能夠直接、安全地訪問物理IB設備,在云環境中保持高性能網絡特性。

- 并行編程模型集成:主流的消息傳遞接口(MPI)實現(如Open MPI, MVAPICH)深度集成RDMA,開發者可以基于此構建低延遲的并行應用程序。

3. 存儲系統開發:

IB是構建高性能存儲網絡(如SAN)和分布式存儲系統(如Lustre, Ceph)的基石。通過IB網卡的RDMA功能,可以實現存儲服務器的遠程內存直接訪問,構建極低延遲的塊存儲(如NVMe over Fabrics - NVMe-oF)和文件系統,極大加速大數據和AI工作負載的數據訪問速度。

4. 網絡協議與算法優化:

軟硬件協同設計是核心。開發者可以在IB的穩定物理層和鏈路層之上,針對特定應用(如機器學習參數同步、金融交易)設計和優化上層通信協議與算法,充分利用硬件卸載特性。例如,設計高效的集合通信原語,以匹配All-Reduce等操作的硬件加速能力。

5. 性能調優與診斷工具開發:

為了充分發揮IB網絡的潛力,需要開發一系列性能監控(如使用perfquery、ibstat)、調試和診斷工具。這包括對計數器、擁塞控制事件、錯誤信息的深入分析,以及開發可視化平臺來洞察大規模IB網絡的健康狀況和性能瓶頸。

與展望

InfiniBand網卡以其革命性的RDMA、超高帶寬和超低延遲特性,已成為驅動前沿計算技術發展的關鍵基礎設施組件。在軟硬件技術開發中,它不僅是實現極致性能的“加速器”,更催生了從硬件設計、系統軟件到應用框架的全棧創新。隨著計算需求向更密集的AI、更復雜的科學模擬發展,對IB網卡特性(如更高速率、更強隔離性、更智能的擁塞控制)的深入理解和應用,將繼續是高性能計算和云數據中心技術開發者必須掌握的核心競爭力。與新興計算范式(如存算一體、量子計算經典接口)的結合,將進一步拓展其技術開發的疆界。